В началото на новата година екипът на MiroMind, ръководен от Chen Tianqiao и Dai Jifeng, пусна MiroThinker 1.5, своя водещ модел с отворен код, базиран на търсене. С размери на параметрите от само 30B и 235B, моделът съвпада — или в някои сравнителни показатели надминава — водещи модели със значително по-голям брой параметри.

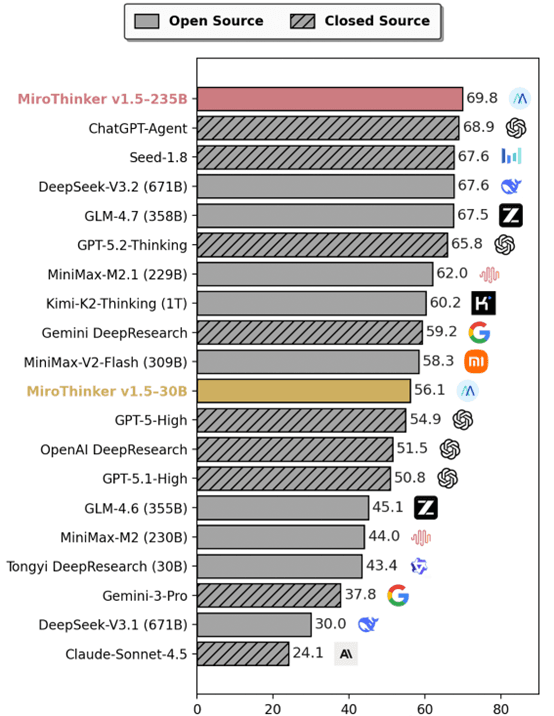

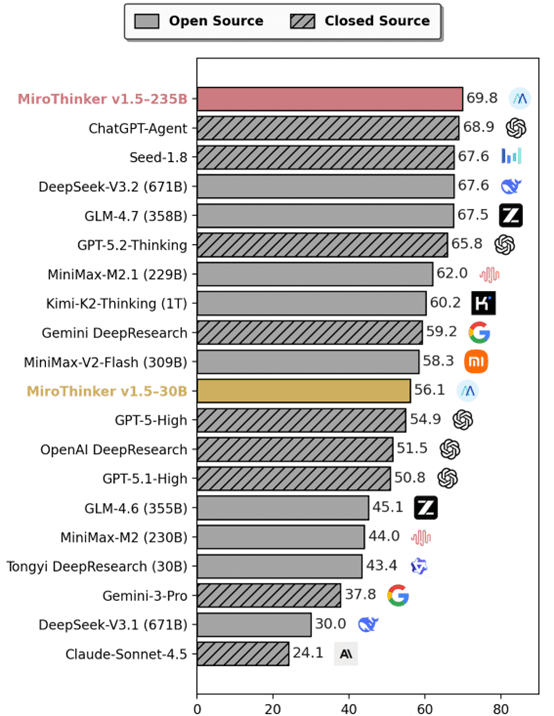

В бенчмарка BrowseComp MiroThinker 1.5 постигна 69,8% резултат, поставяйки нов рекорд. В сравнение с Kimi-K2-Thinking, модел с трилион параметри, версията 30B на MiroThinker 1.5 го надмина с 4,5 процентни пункта на китайския бенчмарк BrowseComp-ZH, като същевременно намали разходите за извеждане на повикване до 0,07 USD – приблизително една двадесета от цената на Kimi-K2-Thinking.

Ключовото предимство на модела се крие в това, което екипът нарича парадигма за „интерактивно мащабиране“. Вместо да разчита само на разширяването на параметрите, MiroThinker дълбоко интегрира цикъла „обосновка–проверка–ревизиране” както в обучението, така и в извода. Чрез активно запитване към външния свят, извършване на многократно валидиране и самокоригиране, моделът подобрява сигурността на разсъжденията и намалява халюцинациите.

Екипът също така представи „чувствителна към времето тренировъчна пясъчна среда“, предназначена стриктно да предотвратява изтичането на модели или използването на бъдеща информация, принуждавайки ги да правят прогнози при непълна информация – по-близо до вземането на решения в реалния свят.

Екипът на MiroMind преди това привлече вниманието с изключително точни прогнози на децентрализирания пазар за прогнози Polymarket. Пускането на MiroThinker 1.5 сигнализира за преминаване от управляван от параметри подход за „вземане на тестове“ към модел в „учен стил“, който увеличава плътността на интелигентността чрез дълбоко взаимодействие с реалния свят.

Източник: QbitAI

Source link

Like this:

Like Loading…

Нашия източник е Българо-Китайска Търговско-промишлена палaта